瑞士聯邦理工學院洛桑分校(EPFL)的研究人員開發了一種機器學習方法來壓縮影像數據,其準確度超過傳統的無學習計算方法,這一發現對視網膜植入物和其他感官義肢具有重要應用價值。

在開發更好的神經義肢方面,一個主要挑戰是感官編碼:將環境中的傳感器捕獲的信息轉換為神經系統可以解釋的神經信號。但由於義肢中電極的數量有限,這些環境輸入必須以某種方式進行縮減,同時仍然保留傳遞給大腦的數據質量。

影像數據壓縮的進步 Demetri Psaltis(光學實驗室)和Christophe Moser(應用光子學裝置實驗室)與Diego Ghezzi合作,應用機器學習解決影像數據多維度(如顏色、對比度等)壓縮問題。他們的目標是降低要通過視網膜義肢傳輸的圖像的像素數量。

機器學習框架:像視網膜一樣編碼圖像 這種基於學習的方法優化了影像壓縮。令人驚訝的是,當使用無限制的神經網絡時,它學會了自行模仿視網膜處理的某些方面。

兩個神經網絡互補工作

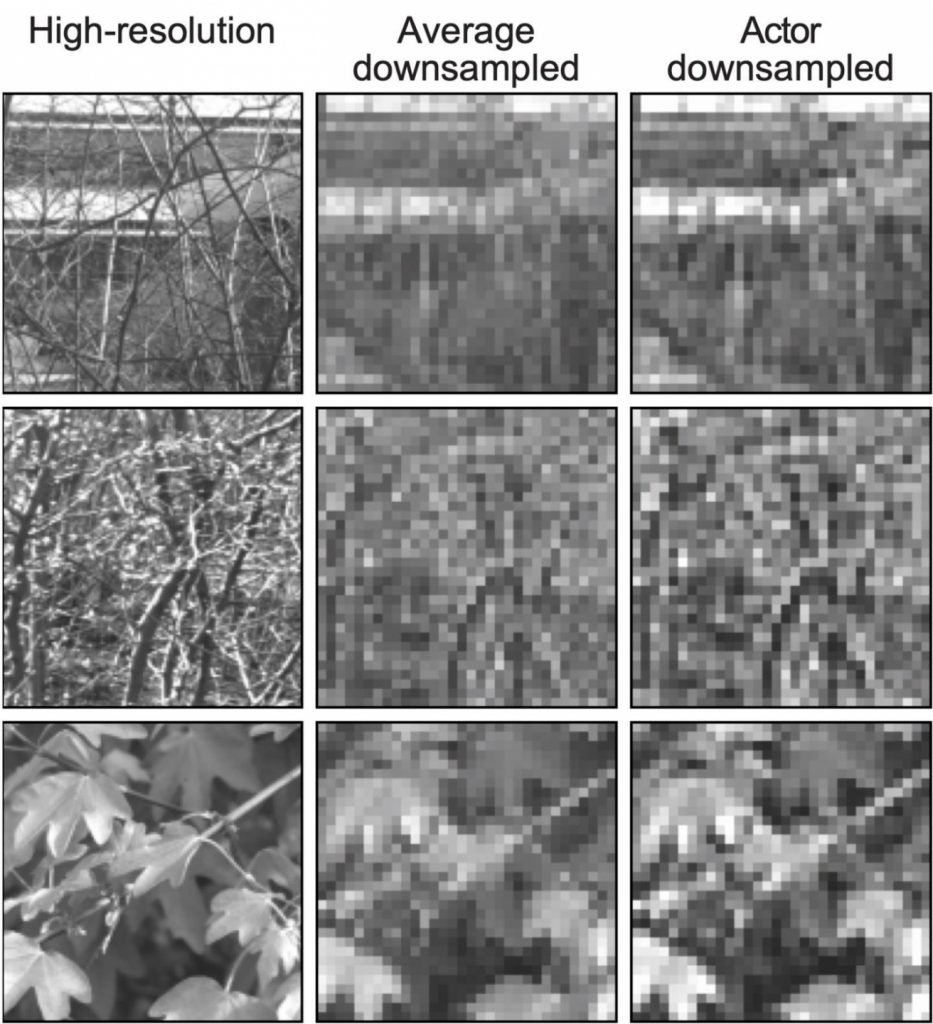

在實驗室和去活組織中的驗證 在這個框架中,兩個神經網絡以互補的方式工作。模型部分,即前向模型,充當視網膜的數字孿生體:它首先被訓練接收高解析度圖像,輸出盡可能接近生物視網膜生成的二進制神經碼的輸出。然後訓練行動網絡,以壓縮高解析度圖像,從前向模型引發的神經碼盡可能接近原始圖像響應生物視網膜所產生的神經碼。

研究人員使用這個框架測試了在數字雙胞胎視網膜和去活的小鼠視網膜上的降採樣圖像。兩次實驗都顯示,行動模型方法產生的圖像比無學習計算方法(如像素平均)產生的圖像引發的神經反應更接近原始圖像。

Ghezzi表示,儘管在使用去活的小鼠視網膜進行實驗中涉及到方法論和倫理挑戰,但正是對他們模型的去活驗證使他們的研究在該領域真正具有創新性。

擴展到其他感官領域 Ghezzi看到了將這個框架的應用擴展到視力恢復,以及超越這一領域的潛力。他補充說,確定這個模型多少適用於人類將是重要的。

Ghezzi說:「顯然下一步是看看我們如何更廣泛地壓縮圖像,超越像素減少,讓這個框架同時處理多個視覺維度。另一種可能性是將這個視網膜模型轉移到大腦其他區域的輸出。它甚至可能與其他裝置(如聽力或肢體義肢)相連接。」

這項研究的結果最近發表在《自然通訊》科學期刊上。

更多科學與科技新聞都可以直接上 明日科學網 http://www.tomorrowsci.com

首圖來源:SciTechDaily.com cc By4.0

影片來源:EPFL cc By4.0

參考論文:

1.An actor-model framework for visual sensory encodingNature Communications

延伸閱讀: